機械学習における「特徴抽出」は、モデルの性能を左右する非常に重要な工程です。大量のデータの中から学習に役立つ情報を取り出すことで、予測精度の向上や処理の効率化が可能になります。本記事では、特徴抽出について機械学習における基本から応用までをわかりやすく解説し、実践的なテクニックや注意点まで丁寧に紹介します。

特徴抽出とは何かを理解しよう

特徴抽出とは、機械学習において生データから有用な特徴(変数)を抽出する工程を指します。モデルがデータを理解・学習しやすくするために、重要な情報を抜き出すことが目的です。画像データであれば「色」「輪郭」「形状」、テキストデータであれば「単語の出現頻度」「文脈」などが特徴の例です。

特徴抽出と特徴選択の違いとは

特徴抽出と混同されやすい概念として「特徴選択」があります。特徴抽出が新しい特徴を作り出すプロセスであるのに対し、特徴選択はすでに存在する特徴の中から最適なものを選び出す作業です。どちらもモデルの性能向上には不可欠であり、目的やデータの性質に応じて使い分ける必要があります。

特徴抽出が重要な理由

特徴抽出は、機械学習の精度を大きく左右する要因のひとつです。良質な特徴を抽出できれば、シンプルなアルゴリズムでも高精度な予測が可能になります。一方で、特徴の質が低ければ、どれだけ高度なアルゴリズムを用いても精度は上がりません。そのため、前処理や特徴量エンジニアリングにしっかりと時間をかけることが重要です。

機械学習における代表的な特徴抽出手法

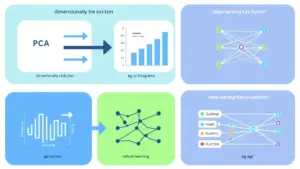

特徴抽出の手法は多岐にわたりますが、代表的なものをいくつか紹介します。

主成分分析(PCA)

高次元データを低次元に圧縮し、重要な情報を保持しながら次元削減を行います。ノイズ除去や可視化にも役立ちます。

TF-IDF(テキストマイニング)

テキストデータにおいて、単語の重要度を評価するための手法です。出現頻度と逆文書頻度を掛け合わせて特徴を抽出します。

畳み込み層(CNN)

画像データの場合、畳み込みニューラルネットワーク(CNN)を使って輪郭や模様などの特徴を自動的に抽出します。

波形・周波数変換(FFTなど)

音声や信号処理では、時間領域から周波数領域への変換によって特徴を抽出します。

特徴抽出で注意すべきポイント

特徴抽出は万能ではなく、いくつかの注意点も存在します。

-

抽出した特徴が本当に目的変数と相関しているかを確認する必要があります。

-

高次元すぎる特徴量は、過学習の原因になることがあります。

-

モデルに適した形式に変換する工程(正規化や標準化)を忘れてはいけません。

特徴抽出を自動化する方法

近年では、AutoMLやディープラーニングの普及により、特徴抽出の自動化も進んでいます。特に画像や音声の分野では、事前学習済みモデルを使うことで、特徴抽出の手間を大幅に減らすことが可能です。ただし、自動抽出された特徴を過信せず、可視化や分析を行うことも重要です。

特徴抽出とモデル精度の関係

モデルの精度は、学習アルゴリズムだけでなく、与えるデータの質にも大きく依存します。特徴抽出を適切に行うことで、予測精度の向上だけでなく、学習スピードの向上やメモリ使用量の削減にもつながります。特に限られたデータで高精度を目指す場合は、特徴抽出の工夫がカギになります。

まとめ

特徴抽出について機械学習における理解と実践は、モデルの性能を大きく左右する重要なプロセスです。単にデータをそのまま使うのではなく、目的に応じた有用な特徴を見つけ出すことが、予測精度を高める近道です。今回紹介した手法やポイントを押さえて、実際のプロジェクトで積極的に活用してみてください。特徴抽出の技術を身につけることで、機械学習のスキルがワンランクアップすることは間違いありません。

コメント